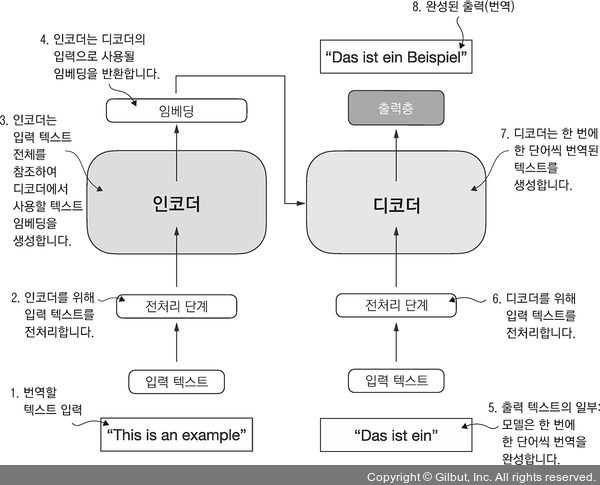

▲ 그림 1-4 언어 번역을 위한 딥러닝 모델인 원본 트랜스포머 구조를 간소화한 그림. 트랜스포머는 두 부분으로 구성됩니다. (a) 인코더는 입력 텍스트를 처리하여 텍스트의 임베딩(embedding) 표현(각각의 차원에서 서로 다른 요소를 포착하는 수치 표현)을 생성합니다. (b) 디코더는 한 번에 한 단어씩 번역된 텍스트를 생성합니다. 이 그림은 원본 입력 텍스트(“This is an example”)와 일부 번역 문장(“Das ist ein”)이 주어졌을 때 디코더가 이 번역을 완성하기 위해 마지막 단어(“Beispiel”)만 생성하는 마지막 번역 단계를 보여 줍니다.