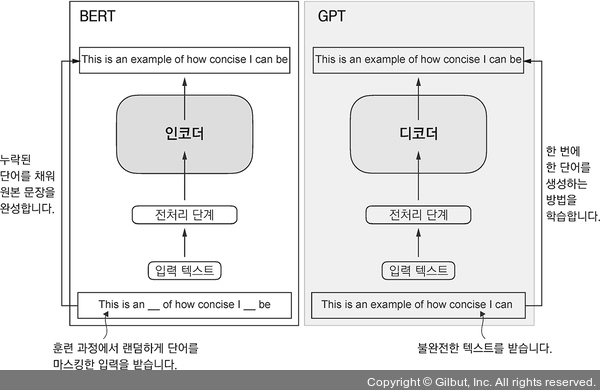

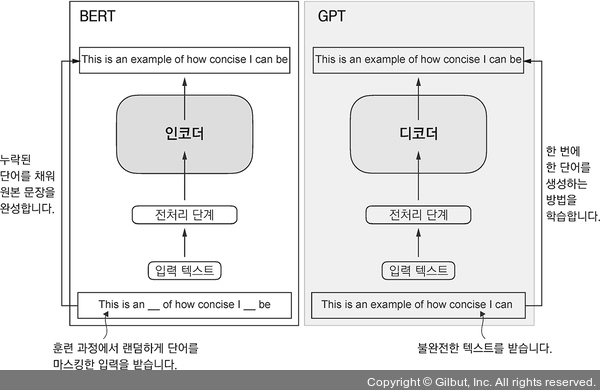

▲ 그림 1-5 트랜스포머의 인코더와 디코더 모듈 구조. 왼쪽의 인코더는 BERT와 유사한 LLM의 예를 보여 줍니다. 마스킹된 단어 예측에 초점을 맞추고 주로 텍스트 분류 같은 작업에 사용됩니다. 오른쪽의 디코더는 GPT와 유사한 LLM의 예입니다. 일관된 텍스트 시퀀스를 생성하는 작업을 위해 고안되었습니다.

▲ 그림 1-5 트랜스포머의 인코더와 디코더 모듈 구조. 왼쪽의 인코더는 BERT와 유사한 LLM의 예를 보여 줍니다. 마스킹된 단어 예측에 초점을 맞추고 주로 텍스트 분류 같은 작업에 사용됩니다. 오른쪽의 디코더는 GPT와 유사한 LLM의 예입니다. 일관된 텍스트 시퀀스를 생성하는 작업을 위해 고안되었습니다.