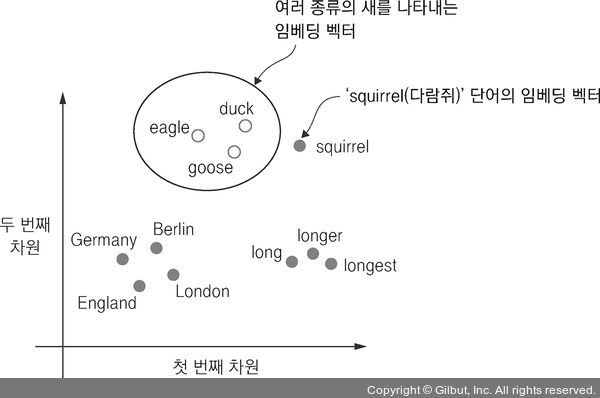

▲ 그림 2-3 단어 임베딩이 2차원이면, 2차원 산점도로 시각화할 수 있습니다. Word2Vec와 같은 단어 임베딩 기법을 사용할 때 비슷한 개념의 단어는 임베딩 공간상에서 서로 가깝게 위치하는 경우가 많습니다. 예를 들어, 여러 종류의 새에 관한 단어는 임베딩 공간상에서 국가와 도시보다 서로 가까이 나타납니다.

Word2Vec와 같은 사전 훈련된 모델을 사용하여 머신러닝 모델을 위한 임베딩을 생성할 수 있지만 LLM은 일반적으로 입력층의 일부로 자체적인 임베딩을 만들고 훈련 중에 업데이트합니다. Word2Vec를 사용하는 대신 LLM 훈련의 일부로 임베딩을 최적화하면 임베딩을 특정 작업과 주어진 데이터에 최적화할 수 있다는 장점이 있습니다. 나중에 이 장 뒷부분에서 임베딩 층을 구현하겠습니다(3장에서 보겠지만 LLM은 문맥이 고려된 출력 임베딩을 만들 수도 있습니다).