SECTION 2.8 단어 위치 인코딩하기

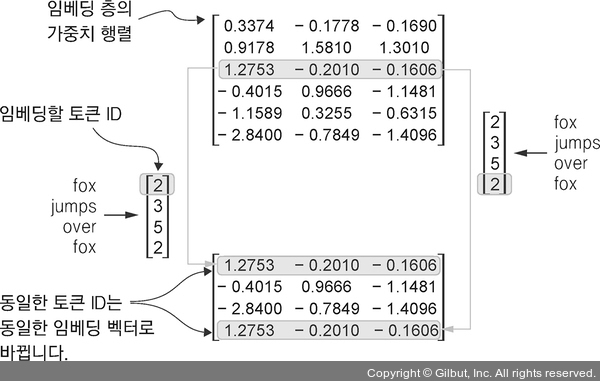

원칙적으로 토큰 임베딩은 LLM의 입력으로 적합합니다. 하지만 LLM의 단점 중 하나는 시퀀스 안의 토큰 위치 또는 순서에 대한 개념이 셀프 어텐션 메커니즘(3장 참조)에 없다는 것입니다. 앞서 소개한 임베딩 층의 작동 방식은 그림 2-17과 같습니다. 입력 시퀀스 안에 토큰 ID의 위치에 상관없이 동일한 토큰 ID를 항상 동일한 벡터 표현에 매핑합니다.

▲ 그림 2-17 임베딩 층은 토큰 ID가 입력 시퀀스의 어느 위치에 있는지 상관없이 동일한 벡터 표현으로 바꿉니다. 예를 들어 입력 시퀀스의 첫 번째 위치에 있는 토큰 ID 2나 네 번째 위치에 있는 토큰 ID 2는 동일한 임베딩 벡터로 바뀝니다.