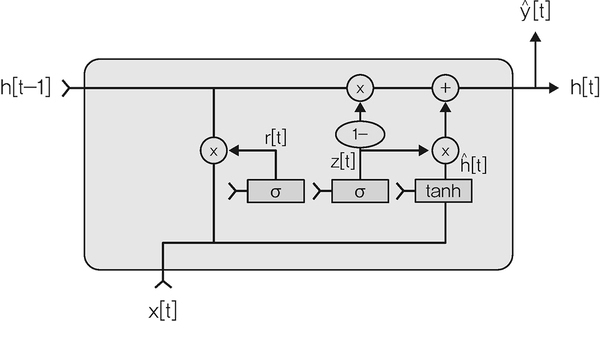

GRU(Gated Recurrent Unit)는 LSTM의 단순화 버전으로, 셀 상태와 은닉 상태를 통합한 단일 상태를 유지하며, 갱신 게이트와 리셋 게이트를 활용해 장기 및 단기 의존성을 효율적으로 학습하는 순환 신경망입니다. 또한, LSTM의 세 가지 게이트(입력, 출력, 망각 게이트)를 두 가지 게이트(갱신, 리셋 게이트)로 단순화해 그 구조가 더 간결합니다.

• 갱신 게이트(update gate): 이전 상태를 얼마나 유지할지와 새로운 입력 정보를 얼마나 반영할지를 동시에 제어합니다. 이는 LSTM의 망각 게이트와 입력 게이트의 역할을 결합한 것입니다.

• 리셋 게이트(reset gate): 이전 은닉 상태의 정보를 얼마나 ‘조절(reset)’할지 결정해 새로운 입력 정보에 더 집중할 수 있도록 돕습니다.

▲ 그림 1-43 GRU 구조