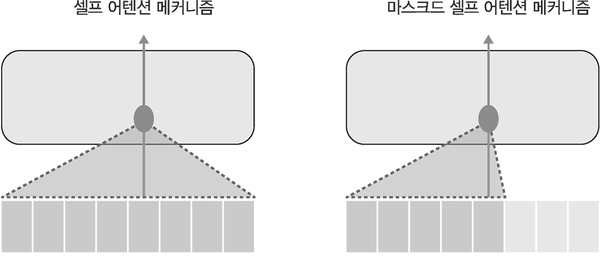

마스크드 셀프 어텐션 메커니즘

마스크드 셀프 어텐션 메커니즘은 트랜스포머 디코더 부분에 적용되는 어텐션 메커니즘으로, 출력 시퀀스를 생성할 때 다음 단어를 보지 못하도록 제한하는 역할을 합니다. 텍스트 생성이나 번역 작업에서 모델이 한 번에 한 단어씩 순차적으로 생성하게 합니다.

트랜스포머 디코더는 이전에 생성된 단어들을 참고하면서 다음 단어를 예측합니다. 이때, 만약 현재 단어뿐 아니라 미래 단어까지 모두 볼 수 있다면 예측이 비논리적이거나 불필요하게 정확해지는 문제(즉, 답을 미리 보는 것과 같은 상황)가 발생할 수 있습니다. 마스크드 셀프 어텐션 메커니즘은 이를 방지하기 위해 디코더가 현재 시점 이전의 단어만 보도록 제한합니다.

▲ 그림 2-15 셀프 어텐션 메커니즘과 마스크드 셀프 어텐션 메커니즘 차이