2.7.1.1 입력 레이어

입력 레이어의 각 노드는 데이터셋의 각 특징 변수(즉, 칼럼)와 같다. 피마 인디안 데이터셋에는 특징 변수가 여덟 개 있으므로 입력 레이어의 노드도 여덟 개다.

2.7.1.2 은닉 레이어

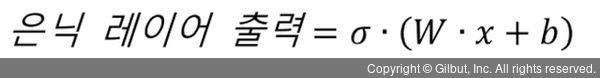

입력 레이어 바로 다음은 은닉 레이어다. 1장에서 설명했듯이 은닉 레이어는 입력 레이어의 출력을 입력받아 비선형 활성화 함수(non-linear activation function)를 계산한다. 은닉 레이어의 함수 공식은 다음과 같다.

x는 이전 레이어가 전달한 입력이며, σ는 비선형 활성화 함수, W는 가중치, b는 편향이다.

예제 모델을 단순하게 만들기 위해 은닉 레이어는 두 개만 사용한다. 은닉 레이어를 여러 개 넣으면 모델 복잡도가 증가하고 훈련 시간도 더 오래 걸린다. 2.9절에서 모델 성능을 확인하겠지만, 은닉 레이어 두 개로도 충분한 정확도를 얻을 수 있다.

2.7.1.3 활성화 함수

신경망 모델 아키텍처를 설계할 때는 각 레이어에 사용할 활성화 함수도 결정해야 한다. 활성화 함수는 마치 신경망의 코어와 같은 중요한 역할을 한다. 즉, 입력을 받아 값을 변환하고 결과를 다음 레이어에 전달한다. 프로젝트에는 ReLU(Rectified Linear Unit)와 시그모이드(sigmoid) 활성화 함수를 사용한다.