21장 설명 가능한 딥러닝 모델 만들기

Deep Learning for everyone ![]()

⦿ 예제 소스 https://github.com/taehojo/deeplearning → 21장. 설명 가능한 딥러닝 모델 만들기 [구글 코랩 실행하기]

⦿ 바로 가기 https://bit.ly/dl3-ch21

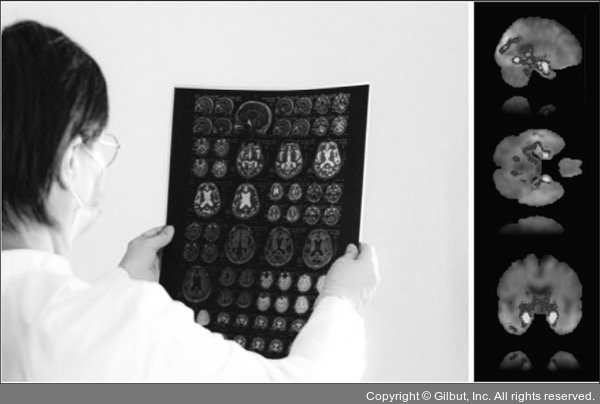

딥러닝으로 알츠하이머형 치매 여부를 판단하는 실험은 상당히 높은 정확도를 보입니다.1 치매에 걸릴 확률이 몇 년 후에 몇 퍼센트인지까지도 예측하기도 하지요. 그런데 이렇게 만든 모델을 실제 의료 현장에서 사용하는 것은 쉽지 않습니다. 꼭 필요한 단계가 있기 때문입니다. 왜 그런 결과가 나왔는지 설명해 주는 단계입니다. 자신의 건강과 생명에 관한 일인데, ‘그냥 딥러닝이 그러더군요’라는 설명을 듣고 싶은 환자는 없을 테지요.

그런데 딥러닝이 왜 그런 판단을 했는지 설명하는 것은 어렵습니다. 다차원 입력으로 인한 계산의 복잡성, 드러나지 않는 은닉층 등 그 중간 과정을 유추해 내기 어렵게 만드는 여러 요소가 있기 때문이지요. 만일 딥러닝이 왜 그런 예측과 판단을 했는지, 그 정확한 근거를 알 수 있다면 환자나 사용자들에게 설명할 수 있을 뿐 아니라, 더 나은 모델을 만들고 더 좋은 데이터를 준비하는 데 도움이 많이 될 것입니다. 이 장에서는 설명 가능한 딥러닝 모델에 대해서 공부해 보겠습니다.